MiniCPM-2B-chat WebDemo部署

MiniCPM-2B-chat 介绍

MiniCPM 是面壁智能与清华大学自然语言处理实验室共同开源的系列端侧大模型,主体语言模型 MiniCPM-2B 仅有 24亿(2.4B)的非词嵌入参数量。

经过 SFT 后,MiniCPM 在公开综合性评测集上,MiniCPM 与 Mistral-7B相近(中文、数学、代码能力更优),整体性能超越 Llama2-13B、MPT-30B、Falcon-40B 等模型。 经过 DPO 后,MiniCPM 在当前最接近用户体感的评测集 MTBench上,MiniCPM-2B 也超越了 Llama2-70B-Chat、Vicuna-33B、Mistral-7B-Instruct-v0.1、Zephyr-7B-alpha 等众多代表性开源大模型。 以 MiniCPM-2B 为基础构建端侧多模态大模型 MiniCPM-V,整体性能在同规模模型中实现最佳,超越基于 Phi-2 构建的现有多模态大模型,在部分评测集上达到与 9.6B Qwen-VL-Chat 相当甚至更好的性能。 经过 Int4 量化后,MiniCPM 可在手机上进行部署推理,流式输出速度略高于人类说话速度。MiniCPM-V 也直接跑通了多模态大模型在手机上的部署。 一张1080/2080可高效参数微调,一张3090/4090可全参数微调,一台机器可持续训练 MiniCPM,二次开发成本较低。

镜像快速使用教程

1. 待实例初始化完成后,在控制台-应用中打开”JupyterLab“

2. 进入Jupyter后,新建一个终端Terminal,输入以下指令

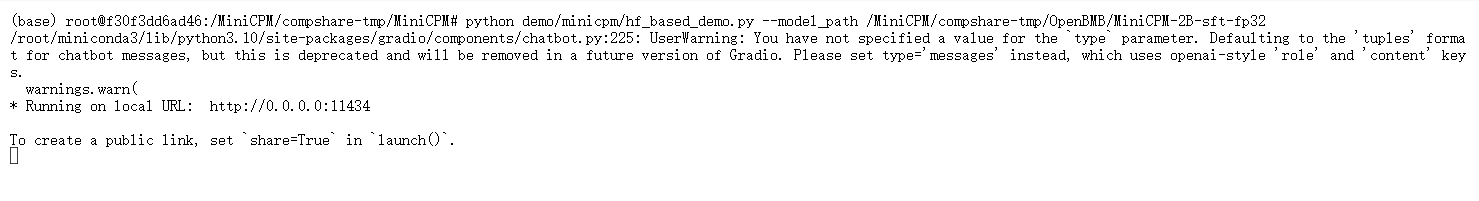

python demo/minicpm/hf_based_demo.py --model_path /MiniCPM/compshare-tmp/OpenBMB/MiniCPM-2B-sft-fp32

3. 运行出现如下结果时,即可在浏览器中访问 http://0.0.0.0:11434 ,其中0.0.0.0替换为外网ip,外网ip可以在控制台-基础网络(外)中获取

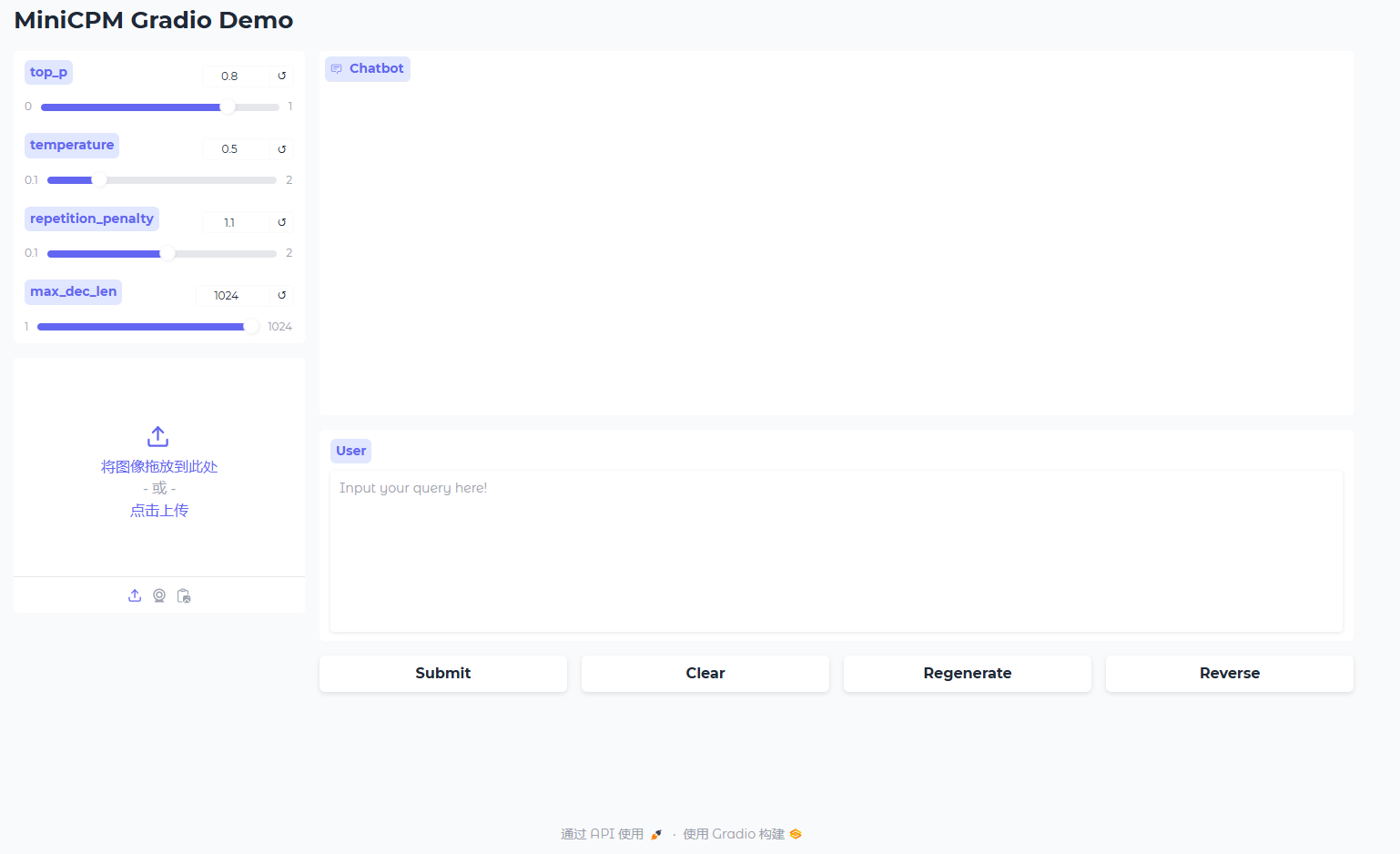

成功进入web界面如下图所示

环境准备

打开其中的终端开始环境配置、模型下载和运行演示。 直接在终端执行以下代码即可完成代码clone及pip换源和安装依赖包

# 更换 pypi 源加速库的安装

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

pip install modelscope transformers sentencepiece accelerate gradio torch

MAX_JOBS=8 pip install flash-attn --no-build-isolation

# clone项目代码

cd /MiniCPM/compshare-tmp

git clone https://github.com/OpenBMB/MiniCPM.git

# 切换到项目路径

cd MiniCPM

注意:flash-attn 安装会比较慢,大概需要十几分钟。

模型下载

使用 modelscope 中的snapshot_download函数下载模型,第一个参数为模型名称,参数cache_dir为模型的下载路径。

在 /MiniCPM/compshare-tmp 路径下新建 download.py 文件并在其中输入以下内容,粘贴代码后记得保存文件,如下图所示。并运行 python /MiniCPM/compshare-tmp/download.py执行下载,模型大小为 10 GB,下载模型大概需要 5~10 分钟

import torch

from modelscope import snapshot_download, AutoModel, AutoTokenizer

import os

model_dir = snapshot_download(OpenBMB/MiniCPM-2B-sft-fp32, cache_dir=/MiniCPM/compshare-tmp, revision=master)

Web Demo运行

进入代码目录,运行demo启动脚本,在--model_name_or_path 参数后填写下载的模型目录

# 启动Demo,model_path参数填写刚刚下载的模型目录

python demo/minicpm/hf_based_demo.py --model_path /MiniCPM/compshare-tmp/OpenBMB/MiniCPM-2B-sft-fp32

在浏览器打开 http://(外部ip):11434 界面,模型加载,即可使用。

扫码加入用户交流群

扫码加入用户交流群